| 執筆者 | 森田 果 (東北大学) |

|---|---|

| 研究プロジェクト | 人工知能等が経済に与える影響研究 |

| ダウンロード/関連リンク |

このノンテクニカルサマリーは、分析結果を踏まえつつ、政策的含意を中心に大胆に記述したもので、DP・PDPの一部分ではありません。分析内容の詳細はDP・PDP本文をお読みください。また、ここに述べられている見解は執筆者個人の責任で発表するものであり、所属する組織および(独)経済産業研究所としての見解を示すものではありません。

産業フロンティアプログラム (第四期:2016〜2019年度)

「人工知能等が経済に与える影響研究」プロジェクト

ディープラーニング技術の発達に伴い、さまざまな局面でのAIの利用が目指されている。しかし、AIの利用によって発生する事故について誰がどのような責任を負うのか、さらには、そのような事故を実効的な形で抑止していくためにはどのような法ルールの設計が望ましいのかについては、明らかにされてこなかった。このため、法ルールの不確実性がもたらす法的リスクが、AI開発企業の一部に対して萎縮効果を与え、わが国のAI産業の発達を阻害しているのではないかとの懸念もある。法ルールの不確実性を除去するための試みも自動運転など一部の分野で始まっているが、AIの利用局面は多様であり、統一的な枠組みに基づいて望ましい法ルール設計を行っていくことが望ましい。そこで本稿は、法の経済分析(法と経済学)の立場から、AIの利用をめぐる法ルールのあり方について、基本的な視点を提示する。

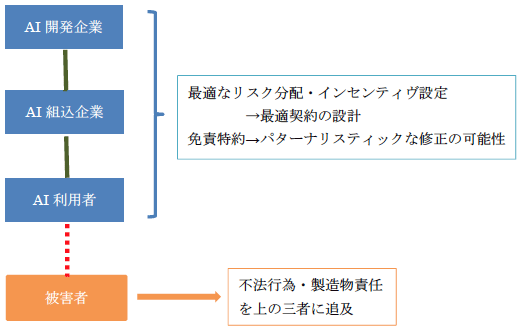

まず、AIをめぐる法的問題の現れ方としては、AIの開発企業、AIを組み込んだ機器・サービスの製造・販売企業、AIの利用者の間で完結する場合(たとえば、AIによる投資アドバイザリーサービスや、AIを活用した医薬品開発サービスなど)と、AIの利用がこれらの第三者以外の者に被害を及ぼす場合(契約外の当事者に外部性を及ぼす場合。自動運転やドローンなど)とが考えられる。前者の場合においては、当事者間で最適なリスク配分やインセンティヴ設定を、契約を利用することによって実現することが期待できるから、従来の最適契約理論などによって対処することができ、新たな法的問題は発生しない。これに対し、後者の場合においては、民法や製造物責任法が直接適用され、契約による対処ができないから、AIの介入がこれらの法ルールの適用上、どのような帰結を導くかを考える必要が出てくる。

具体的には、100%完全なAIを開発することが現実には不可能であることを出発点とする。そうすると、AIの利用によって発生する事故というのは、AIの開発者側に起因する要因、AIを組み込んだ機器・サービスの製造販売者に起因する要因、AIの利用者側に起因する要因とが組み合わさって発生する、いわゆる双方的注意の事案であることが多いと予想される。この場合、これら三者全てに適切なレベルの注意を尽くすインセンティヴを与えることによって初めて、AIの利用に起因する事故を効果的に抑止することができる。そうすると、いわゆる双方的注意の事案に該当するといえるから、全ての当事者に適切なインセンティヴを設定するためには、過失責任ルールあるいは寄与過失の抗弁つきの厳格責任ルールが望ましいといえる。そして、全ての当事者が適切な注意水準を尽くしていた場合の残余的な責任を引き受けるべき者は、行為水準のコントロールの必要性、裁判所による過失判断の困難性、リスク選好を考慮すると、AIを組み込んだ機器・サービスの製造・販売者になることが多いであろう。

以上のような「社会的に望ましい」損害賠償法ルールの構造は、わが国の現行の不法行為法(民法)・製造物責任法においても、基本的に採用されている。もちろん、AIの利用に伴っては過失の立証が難しくなる分、立証責任の転換などの追加的な手当てが必要になる可能性はあるものの、現行法は、基本的に望ましい責任ルールとしての構造を持っていると評価できる。そうすると、AIの開発企業や、AIを組み込んだ機器・サービスを製造・販売する企業、さらには、それらの機器・サービスを利用する企業は、通常の注意を尽くしていれば、多くの場合、責任を免れることができるし、仮に責任を引き受ける結果となっても、その範囲は合理的なものに収まる蓋然性が高いと予想される。

したがって、AIの利用を考えている企業は、AIの利用によって莫大な法的責任を引き受けざるを得ないのではないか、という懸念から、AIの利用をためらう必要性は低い。通常の注意水準を尽くしている限りにおいて、深刻な問題は発生しにくいと考えてよいだろう。

もっとも、現行法(あるいは望ましいあるべき法ルール)を前提としても、AIの利用を考えている企業が注意しなければいけない事項が1つある。AIを利用する際には、売り込みのために、しばしばAIの機能の高さを喧伝することがあると予想されるが、そのあまりにAIの機能の限界についての正確な情報を伝達することを怠っていると、それが責任原因に結びつく可能性が高い、という点である。AIの機能の限界を正しく知って初めてAIを正しく利用してAIに起因する事故を抑止できるのであるから、この点には注意深くあることが必要である。